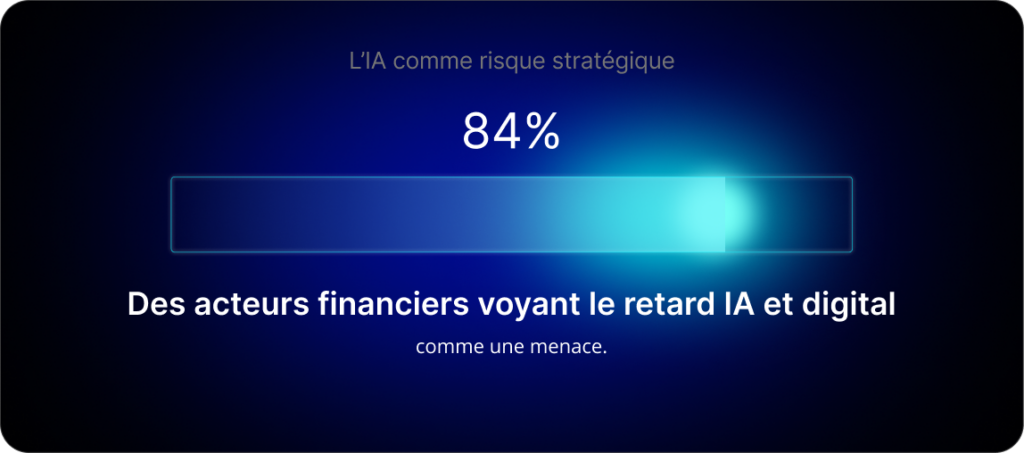

Il ne fait aucun doute que l’intelligence artificielle a rapidement transformé le secteur bancaire et financier, en remodelant un éventail de fonctions essentielles, comme la détection de la fraude, l’accélération des décisions de crédit, une meilleure gestion des risques et la conformité réglementaire et, désormais, l’explicabilité de l’IA. Près de la moitié des personnes interrogées dans le cadre d’une étude PwC de 2025 s’attendent à ce que la technologie améliore leurs réductions de coûts d’au moins 10 %, tandis que 84 % des entités financières estiment que le fait de ne pas adopter l’IA et la digitalisation au cours des cinq prochaines années aura un impact négatif sur leurs modèles économiques. Une recherche de McKinsey projette également que l’IA générative pourrait ajouter entre 200 et 340 milliards de dollars de valeur par an au secteur bancaire mondial, principalement grâce à une productivité accrue.

Cependant, à mesure que l’IA pour la finance gagne en sophistication, un enjeu majeur émerge : la confiance. En effet, parmi les modèles les plus performants d’aujourd’hui, bon nombre fonctionnent comme des « boîtes noires », générant des résultats difficiles à expliquer ou à comprendre, tant pour l’entreprise que pour les utilisateurs finaux, selon Hani Hagras, Chief Science Officer and Global Head of Artificial Intelligence chez SBS.

Or, dans une industrie fortement réglementée où les décisions impactent directement la vie de milliers de personnes, une telle opacité, autrement dit un manque d’explicabilité de l’IA, n’est plus acceptable, ajoute Hagras. Par ailleurs, alors que les régulateurs mondiaux intensifient leurs efforts pour superviser l’IA dans la finance, de l’AI Act de l’UE aux orientations de surveillance du Royaume-Uni, l’explicabilité devient une exigence déterminante pour une IA responsable.

Ainsi, la question n’est plus de savoir si les banques devraient adopter l’IA, mais si elles peuvent le faire d’une manière qui reste transparente, défendable et digne de confiance, affirme Hagras lors d’une discussion avec Andrew Steadman, Chief Product Officer chez SBS, au summit Adopt AI à Paris.

Pourquoi l’explicabilité dans l’IA est-elle essentielle en finance ?

L’explicabilité signifie être capable de comprendre clairement comment le modèle d’IA fonctionne et comment il prend des décisions spécifiques. Aujourd’hui, l’IA peut tarifer un prêt en quelques secondes et détecter la fraude en millisecondes, elle fait les choses plus rapidement et plus précisément que n’importe quelle équipe humaine ne pourrait jamais le faire.

Mais voici le hic : si vous demandez à des dirigeants comment l’IA fonctionne réellement, la plupart seront incapables de répondre. Cela se reflète dans un rapport de 2024 co-publié par la Financial Conduct Authority du Royaume-Uni et la Banque d’Angleterre, qui a constaté que seulement 46 % des entreprises ont une « compréhension partielle » des technologies d’IA qu’elles utilisent contre 34 % qui déclarent en avoir une « compréhension complète ».

Pendant ce temps, l’AI Act de l’UE décrit l’explicabilité comme une « obligation fondamentale » pour tout système qui impacte le crédit, l’assurance ou les moyens de subsistance. Le comité spécial sur l’IA de la Chambre des Lords du Royaume-Uni dit qu’il est inacceptable qu’une IA qui impacte matériellement la vie d’une personne fonctionne sans une « explication satisfaisante ».

Pourquoi l’explicabilité dans l’IA est-elle un défi dans le secteur des services financiers ?

L’IA dans la finance est devenue à la fois incroyablement puissante et dangereusement opaque. La complexité même qui la rend précise la rend également non interprétable. En finance, c’est inacceptable. Ces modèles d’IA décident qui obtient un prêt, comment les marchés évoluent et comment les capitaux circulent. Si nous ne pouvons pas expliquer ces décisions, nous perdons bien plus que la conformité réglementaire, nous perdons la confiance.

Le point de vue du comité de politique financière de la Banque d’Angleterre sur les risques est clair : « Bien que les caractéristiques distinctes de l’IA soient la source de ses avantages uniques, elles peuvent également être des sources de risque supplémentaires », dit-il.

« Par exemple, la complexité de certains modèles d’IA – associée à leur capacité à changer dynamiquement – pose de nouveaux défis concernant la prévisibilité, l’explicabilité et la transparence des résultats des modèles. »

Nous avons déjà vu des problèmes survenir à partir de modèles d’IA prenant des décisions de crédit discriminatoires. L’un des exemples les plus connus est peut-être l’Apple Card, qui a fait l’objet d’une enquête du département des services financiers de New York en 2019. Sur le papier, l’algorithme derrière l’Apple Card fonctionnait et était très précis, rapide et évolutif. Mais dans la pratique, il a commencé à accorder aux femmes des limites de crédit inférieures à celles des hommes, même lorsque leurs profils financiers étaient identiques.

Apple a appelé cela un problème technique. Les régulateurs ont appelé cela de la discrimination. Mais la vérité est que ce n’était ni l’un ni l’autre – c’était un système que personne ne pouvait facilement expliquer ou enrichir avec des connaissances humaines et une gouvernance. Et c’est là le point : l’explicabilité n’est plus un idéal académique ; c’est une question de survie – à la fois pour les banques, pour les régulateurs et pour chaque client qui mérite de savoir pourquoi une machine a pris une décision qui façonne sa vie.

L’explicabilité signifie-t-elle que nous échangeons l’intelligence contre la clarté ?

C’est un mythe. Historiquement, les systèmes explicables étaient plus simples et les banques utilisaient la régression logistique. Elle était facile à auditer, mais sa précision était limitée en raison de la simplicité du modèle et du faible nombre de variables utilisées pour rester explicable. Puis, est venu l’apprentissage profond, avec des milliers de caractéristiques, offrant des précisions très élevées mais impossible à lire, analyser ou augmenter avec des connaissances humaines. Tout le monde supposait qu’on ne pouvait pas avoir les deux.

Cependant, des travaux récents ont montré que les modèles explicables sont désormais proches de la précision des systèmes “boîtes noires” dans de nombreux domaines, y compris les applications financières. Donc cette vieille excuse selon laquelle un modèle mystérieux et trop compliqué permet d’obtenir de meilleurs résultats n’est plus vraie. Il est désormais possible d’allier précision et transparence totale, tout en garantissant auditabilité et conformité réglementaire, pour offrir une sérénité complète aux entreprises et aux utilisateurs.

En employant l’IA explicable, les structures de raisonnement sont intégrées directement aux modèles. Résultat : la transparence ne se fait plus au détriment de la performance. L’explicabilité donne une IA qui pense comme un scientifique et parle comme un banquier.

Comment les directeurs techniques bancaires ou les responsables des risques devraient-ils aborder l’explicabilité de l’IA?

Pour l’IA prédictive (qui fait des prédictions affectant la vie des personnes), il y a deux voies :

- Explicabilité post-hoc : il s’agit de construire un modèle de « boîte noire », puis d’utiliser des outils comme SHAP ou LIME pour interpréter ses résultats. Mais en partant d’un modèle entièrement piloté par les données, dont la qualité dépend entièrement de celles-ci, il devient impossible d’y intégrer les connaissances humaines pour combler les lacunes ou corriger les biais. Résultat : c’est comme essayer de lire des signaux de fumée après l’incendie.

- Explicable dès la conception : ici, la transparence est pensée dès le départ. Les modèles utilisent des architectures hybrides basées sur des règles et traitements linguistiques. Ils mêlent apprentissage à partir des données et connaissances expertes, comme l’intuition des banquiers humains, offrant ainsi une IA à la fois performante et compréhensible.

Ces systèmes permettent de poser le pour et le contre. Par exemple, ils peuvent préciser : « Votre score est de 600 parce que votre ratio d’endettement est élevé ; cependant, votre historique de remboursement reste solide. »

De plus, pour l’IA générative, l’explicabilité doit être intégrée directement dans la sortie des systèmes. En effet, sans explication claire, les utilisateurs ne peuvent pas comprendre la logique suivie. Ainsi, les systèmes doivent détailler, dans un langage accessible, les différentes étapes et analyses utilisées pour produire un résultat. En d’autres termes, l’objectif est d’assurer une logique traçable. Par conséquent, l’IA devient un outil compréhensible. Finalement, elle se transforme en collègue transparent plutôt qu’en mystère opaque.

Et les données le prouvent : selon l’enquête 2025 de PwC sur l’IA responsable, près de 60 % des personnes interrogées affirment que les initiatives d’IA responsable améliorent le retour sur investissement et l’efficacité organisationnelle, tandis que 55 % disent qu’elles améliorent à la fois l’expérience client et l’innovation. À chaque grande révolution technologique, il y a des gagnants et des perdants. Ainsi, pour faire partie du groupe gagnant, il est essentiel de se rappeler que l’IA en finance ne pourra se déployer pleinement que si elle est fiable.

Cependant, tout ce potentiel dépend d’un seul mot : la responsabilité. Autrement dit, être responsable signifie être auditable, équitable et explicable. En effet, sans explicabilité, les biais s’accumulent, les enquêtes se multiplient et la méfiance des clients s’installe. À l’inverse, avec elle viennent la confiance, l’adoption et un avantage concurrentiel tangible. En définitive, la finance reste une industrie profondément humaine, et la confiance en est la véritable monnaie.

Pour plus d’informations sur les perspectives du secteur et l’innovation, abonnez-vous à notre newsletter ou visitez notre page « Insights ».

Contactez nos experts dès aujourd’hui.

Questions-Réponses : L'explicabilité dans l'IA

Qu'est-ce que l'explicabilité dans l'IA ? + –

L’explicabilité dans l’IA revient à comprendre clairement comment le modèle d’IA fonctionne et comment il prend des décisions spécifiques. Dans les services financiers, cela implique de fournir une logique transparente et traçable pour les décisions concernant les prêts, les scores de crédit, la détection de fraude et autres opérations critiques.

Comment l'AI Act de l'UE affecte-t-il les exigences d'explicabilité ? + –

L’AI Act de l’UE définit l’explicabilité comme une obligation fondamentale pour les systèmes d’IA qui affectent le crédit, l’assurance ou les moyens de subsistance des individus. Les institutions financières doivent être en mesure de documenter, d’auditer et d’expliquer comment les modèles d’IA fonctionnent, y compris leurs données d’entraînement, leur logique et leurs processus de prise de décision.

Quel rôle joue l'explicabilité dans l'IA responsable ? + –

L’explicabilité est un pilier fondamental de l’IA responsable, aux côtés de l’équité, de l’auditabilité et de la responsabilité. Sans explicabilité, les institutions ne peuvent pas prouver que leurs systèmes d’IA se comportent de manière éthique ou légale. Avec elle, l’IA devient défendable, digne de confiance et alignée sur les valeurs humaines.

L'explicabilité est-elle uniquement une question de conformité ? + –

Non. Bien que l’explicabilité soit une exigence réglementaire, elle constitue également un avantage stratégique. Les systèmes d’IA transparents sont plus faciles à développer, plus sûrs à déployer et plus résilients face aux changements réglementaires. L’explicabilité permet une innovation responsable plutôt que de la ralentir. En fin de compte, les humains font confiance à ce qu’ils peuvent comprendre.